华为首次开源大模型 推动AI创新与发展

article/2025/6/30 22:04:42

华为于6月30日正式宣布开源盘古70亿参数的稠密模型、盘古Pro MoE 720亿参数的混合专家模型以及基于昇腾的模型推理技术,这是华为首次开源大模型。目前,盘古Pro MoE 72B模型权重和基础推理代码已上线开源平台,基于昇腾的超大规模MoE模型推理代码也已上线。盘古7B相关模型权重与推理代码将在近期上线开源平台。华为邀请全球开发者、企业伙伴及研究人员下载使用。

华为表示,此举是其践行昇腾生态战略的关键举措,旨在推动大模型技术的研究与创新发展,加速人工智能在各行各业的应用与价值创造。达睿咨询创始人马继华介绍,盘古70亿参数的稠密模型采用全参数稠密结构,适合通用场景微调,能够灵活部署在边缘设备上。而盘古Pro MoE 72B模型则采用混合专家架构,在保持推理效率的同时实现接近千亿级稠密模型的性能,适用于高复杂度任务。华为通过差异化模型参数规模梯度覆盖制造业、金融等不同场景需求,开源目的是推动大模型在行业中的应用落地。马继华认为,当前人工智能领域的技术开放与生态共建至关重要,通过开源可以迅速形成产业优势,从而达成领跑,发挥人工智能的飞轮效应。

相关文章

安青、王敏履新出任驻外大使 三位大使分别抵任

高文棋任中国驻卢旺达大使。6月27日,他作为第十六任大使抵达基加利履新,受到卢外交部代表和驻卢使馆主要外交官的迎接。高文棋出生于1972年1月,本科学历,中共党员,曾任中国驻希腊使馆政务参赞和外交部新闻司参赞。2023年2月至2025年4月期间,他曾挂职担任湖南省长沙市副市…

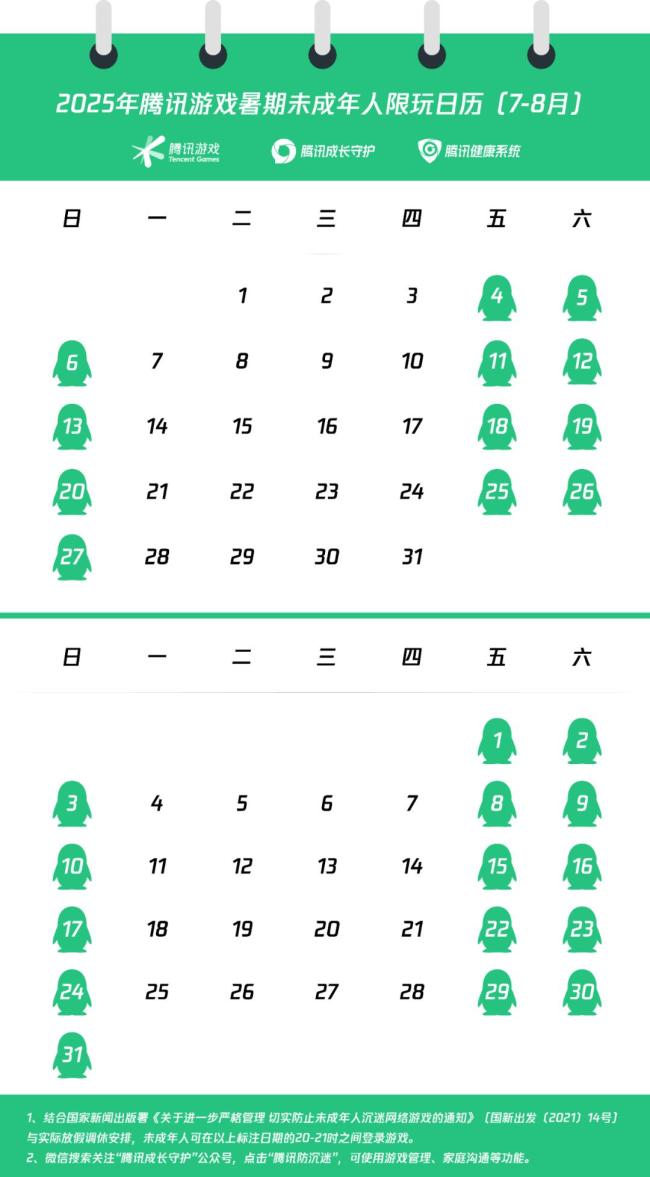

未成年暑假可玩27小时游戏 限时防沉迷措施出台

随着暑期的到来,未成年人对网络的使用需求显著增加。为防止未成年人沉迷游戏,网易游戏和腾讯游戏于6月30日发布了2025年暑期未成年人限玩日历(7月1日至8月31日)。两家公司均采取了严格的时段限制措施,规则基本相同。根据规定,在暑假期间,未成年人只能在每周五、六、日晚…

男子潜入朋友家偷古董不料全是仿品 盗窃者被刑拘

近日,重庆的陈某报警称其家中珍藏的古钱币、玉石珠等10余件古董被盗。警方调查后发现,是陈某的朋友黄某趁陈某家中无人时潜入室内实施盗窃。然而,黄某没想到的是,他所盗来的“古董”经鉴定全为仿品。由于黄某有犯罪前科,且入户盗窃无论金额高低都应追究刑事责任。目前,黄…

今年阅兵有哪些看点亮点燃点 新舰载机与编队变化备受期待

9月3日,北京天安门广场将举行纪念中国人民抗日战争暨世界反法西斯战争胜利80周年的大会,包括检阅部队。自党的十八大以来,中国特色社会主义进入新时代,国防和军队建设也迈入了新的阶段。13年间,多次盛大的阅兵式彰显了军威国威,并载入人民军队的史册。关于此次阅兵的看点…

女子在成都绿道骑行被鱼线绊倒 安全隐患引关注

近日,家住成都的刘女士在江滩公园绿道骑自行车时被一根鱼线绊倒,全身多处受伤。6月30日,她详细描述了事发经过。刘女士回忆说,事情发生在6月26日晚上8点左右,她在绿道上正常骑行。刚上桐锦桥时,突然感到一根线横在路中间,勾到了她的脸。由于来不及刹车,她直接飞了出去,…

作家文章被选成阅读题 自己都答不对 作者也困惑

青年作家王彤乐最近发帖称,自己发表的一篇文章被选为上海市虹口区初二语文期末考试的试题。但他在做题时发现,其中一道选择题自己答错了,另外三道偏主观的题也答得不够全面。原文《蓝气球和甜月亮》曾在《青年文摘》上发表,并在阅读理解中作为材料出现,共设了4道题,总分1…

河南强降水再上线 警惕强对流!

据河南气象,今明两天河南省将经历一次明显的降水过程。预计今天午后至17点前后,豫北地区的降水会明显加强,傍晚前后西南部的降水也会显著增强。此次降水范围广、强度大,北部、中西部、西南部部分县市有中到大雨,局部暴雨或大暴雨,并伴有短时强降水、雷暴大风等强对流天气…

韩星李准基大变样 沧桑到认不出 机场照引发热议

韩国男神李准基最近在日本成田机场被偶遇,一组未修图的近照引发网友热议。照片中的他戴着鸭舌帽、珍珠项链,穿搭依旧时尚,但整个人瘦到脱相,面部轮廓变化明显,甚至有人第一眼没认出来:“这是李准基?怎么跟记忆里的样子差这么多?”李准基凭借《王的男人》中的孔吉、《一…

男子骗12岁女孩开房被暴打?警方回应 父亲怒火中烧

最近,一段男子当街被暴打的视频在网上广泛传播。视频中,被打男子没有还手,看起来像是在等待警察到来处理。然而,事实并非如此简单。被打者来自四川眉山,施暴者则是四川彭山人。事件起因是眉山男子带着一个12岁的女孩去开房,结果被女孩的父亲发现。女孩的父亲得知后非常愤…

中通快递回应LABUBU盲盒仅剩6个裸娃 补发并赔偿200元

随着泡泡玛特旗下产品拉布布的火爆,二手平台上多款拉布布手办、盲盒出现不同程度溢价。然而,近期部分网友在社交平台反映,网购的拉布布盲盒及周边产品在收货时出现胶带被撕开、快递箱被损坏等问题,怀疑快递盒在收件前已被他人拆开,相关产品可能已被偷换。前不久,罗女士网…

俄罗斯与伊朗的关系被高估了吗 历史恩怨与现实利益交织

俄罗斯和伊朗在许多人眼中似乎是攻守相依的盟友,但事实并非如此。以色列对伊朗发起袭击后,俄罗斯并未帮助伊朗反击。这背后的原因是复杂的。实际上,俄罗斯和伊朗至今都还不是正式的盟友。双方签署的无上限合作条约中并没有涉及军事方面的条款,这意味着两国之间并不存在军事…

5岁女孩街头敲警车求助 母女获特警及时援助

6月20日,湖北省建始县的沈女士走在街上时突然感觉身体不适,呼吸不畅且手脚发麻。无力之下她只能就近坐在路边。这时,她看到不远处停着一辆闪着警灯的特警车,便让5岁的女儿向警察叔叔求助。乖巧懂事的女儿一路小跑,越过路边栏杆,踮起脚尖敲响了警车车门。接到小女孩的求助…

印度一大楼墙体开裂如纸牌屋般倾倒 暴雨后倒塌险情

印度一大楼墙体开裂如纸牌屋般倾倒 暴雨后倒塌险情。6月30日,印度西姆拉一栋五层大楼在暴雨后倒塌,墙体开裂,如“纸牌屋”般倾倒。这栋大楼此前已出现裂缝,楼内人员于29日晚被疏散。初步评估认为,该地区正在修建公路可能是导致大楼底部出现裂缝的原因。幸运的是,事故未造…

男子婚内打赏女主播双方互称老公老婆 法院判决返还部分款项

男子婚内打赏女主播双方互称老公老婆 法院判决返还部分款项。男子来某在网上认识女主播童某后,两人互称“老公”“老婆”,童某还以后续会结婚等要求来某打赏。来某在7个月内通过平台向童某的账号打赏价值148万余元的礼物。来某妻子祝某与他离婚后,起诉要求童某扣除平台抽成后…

44岁阿娇坦言自己有身材焦虑 减肥不易引共鸣

近日,阿娇(钟欣潼)在参加其主演的电影《好好说再见》路演前接受采访时提到自己有身材焦虑,一句“减肥对我来说真的不容易”引发了广泛讨论。许多网友表示感同身受,认为连女明星也逃不过中年发福的问题。44岁的阿娇坦言她的焦虑主要集中在身材上,她自认为是易胖体质,随着…

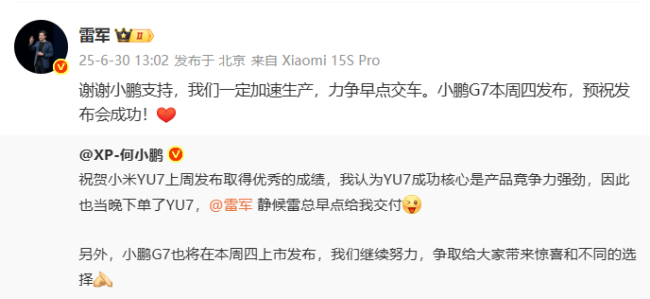

雷军回应何小鹏下单小米YU7 感谢支持加速生产

6月30日,雷军回应小鹏汽车董事长何小鹏:“谢谢小鹏支持,我们一定加速生产,力争早点交车。小鹏G7本周四发布,预祝发布会成功。”此前何小鹏曾发文祝贺小米YU7上周发布取得优秀成绩,并表示自己也下单了YU7,期待早日交付。6月26日,小米YU7正式上市,市场反响热烈。开售1小…

澳官员那个酸:大家只记得中国,可我们也出了钱的 中国影响力成“烦心事”

澳大利亚官员对中国与太平洋岛国的合作表达了不满。据英国《卫报》报道,澳大利亚太平洋事务部部长帕特康罗伊声称,中国对多边发展项目进行“品牌化包装”,以增强在该地区的影响力,这成了澳政府的一大“烦心事”。康罗伊抱怨称,中国把亚洲开发银行的项目“打上中国标签”,…

安普瑞斯回应充电宝电芯问题 原料变更引隐患

近日,部分充电宝因安全问题被召回,无3C认证的充电宝也被禁止带上境内航班,引起广泛关注。有充电宝厂家表示,某供应商的部分批次电芯存在未经批准的原料变更,可能导致极少数产品在长期使用后隔膜绝缘失效,引发过热甚至燃烧的安全隐患。媒体报道称,两家企业召回充电宝的原…

5岁女童感染“食脑虫”昏迷不醒,病情凶险 病死率高达98%

最近,一名家长在社交平台上发布求助信息,引起广泛关注。该家长称带5岁女儿于6月7日和6月14日游泳和泡温泉,6月22日孩子出现头痛、低热和呕吐症状,6月23日住进医院后出现抽搐,随后昏迷不醒,并转入重症监护室治疗。6月27日,检测结果显示孩子感染了福氏耐格里阿米巴病原,情…

上海动物园建议带娃游客喂完奶再进 母婴室设置引争议

近日,有网友称其带10月龄婴儿游览上海动物园时,在展馆内用奶瓶喂孩子被驱赶,引发关注。相关话题登上热搜。茅先生一家于6月14日上午近11点到达上海动物园。游览约15分钟后,孩子表现出饥饿,他们打算在园内找个阴凉处给孩子喂奶。但公园唯一的母婴室位于大门外的游客服务中心…