目录

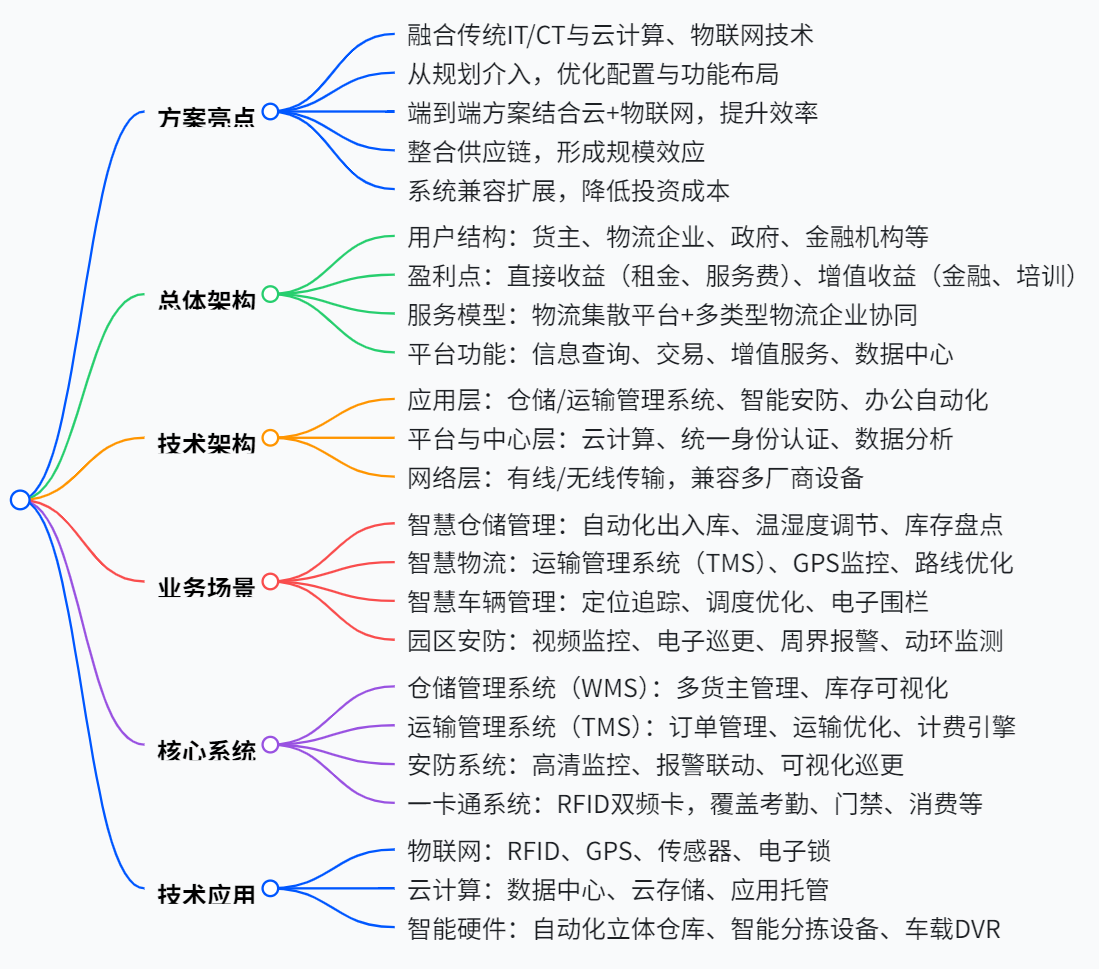

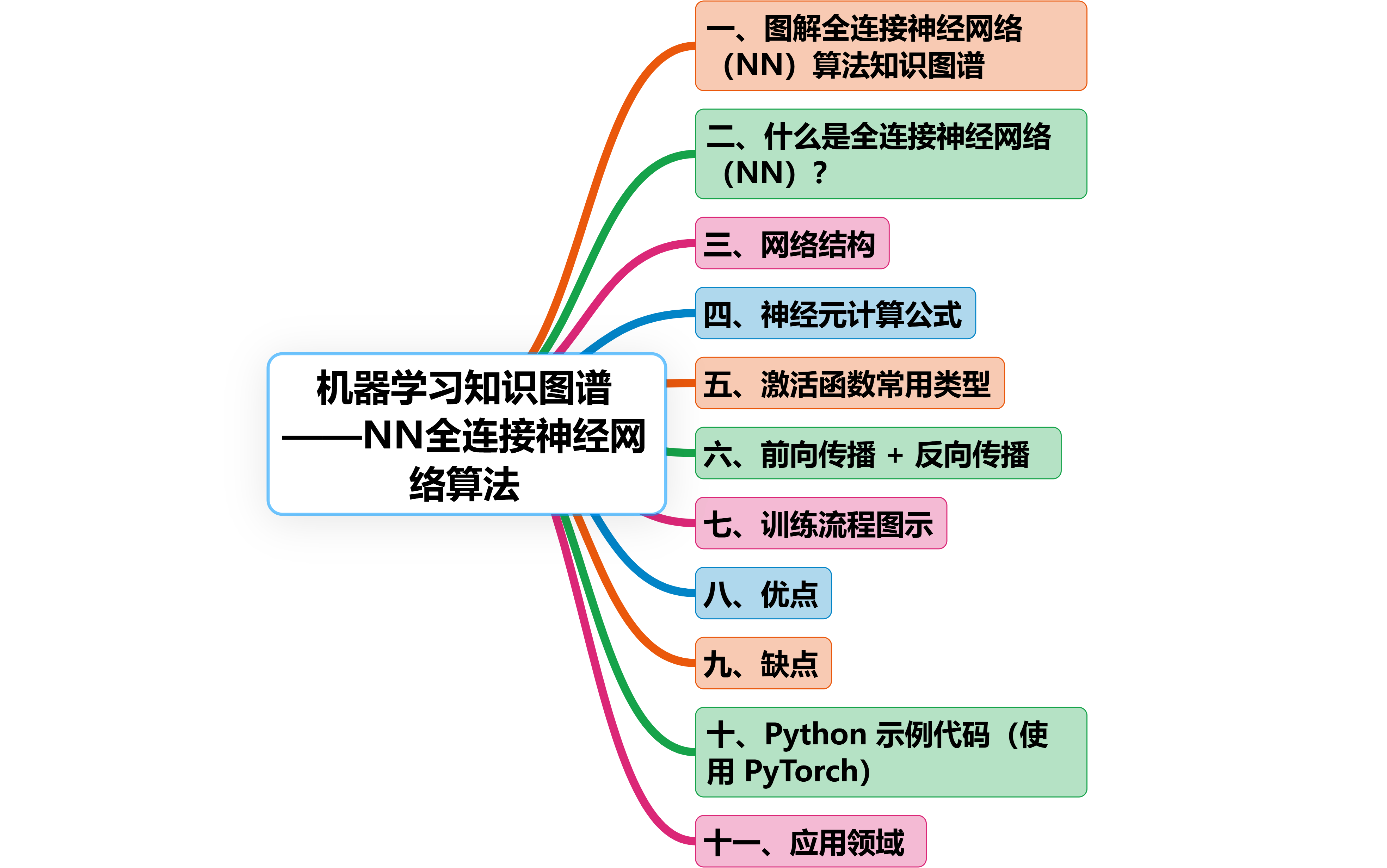

一、图解全连接神经网络(NN)算法知识图谱

二、什么是全连接神经网络(NN)?

三、网络结构

四、神经元计算公式

五、激活函数常用类型

六、前向传播 + 反向传播

七、训练流程图示

八、优点

九、缺点

十、Python 示例代码 (使用 PyTorch)

十一、应用领域

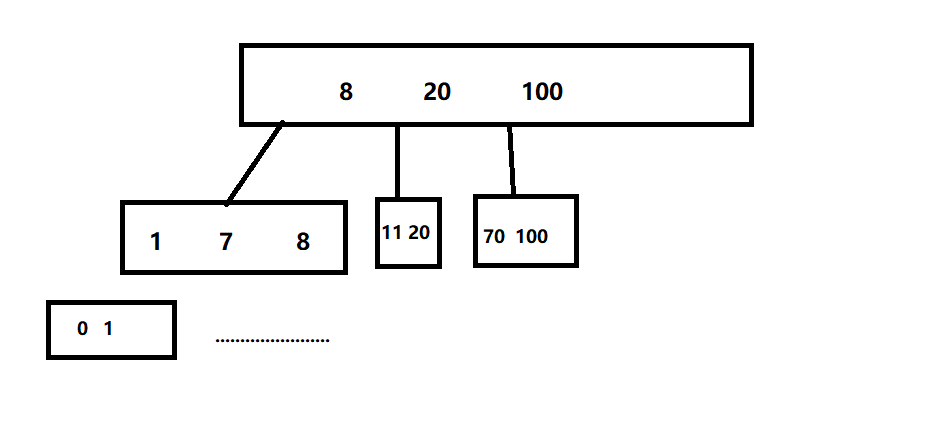

一、图解全连接神经网络(NN)算法知识图谱

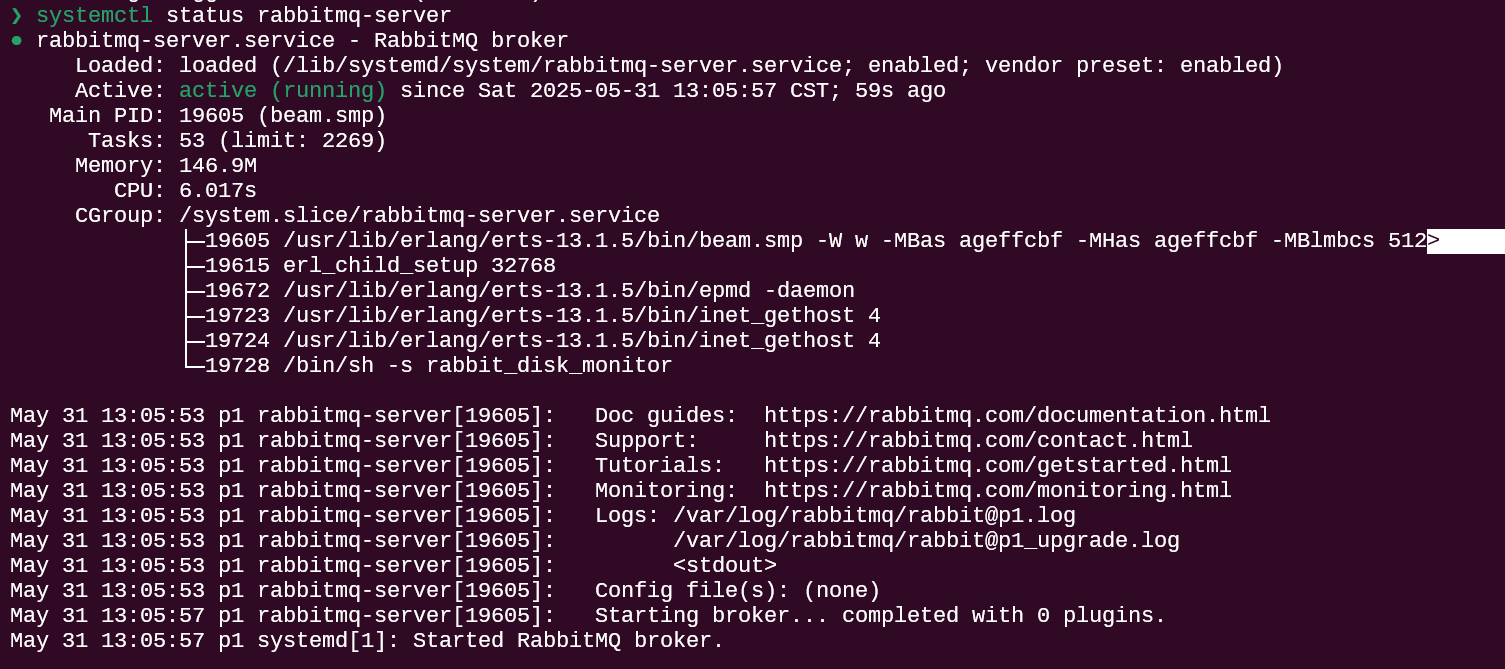

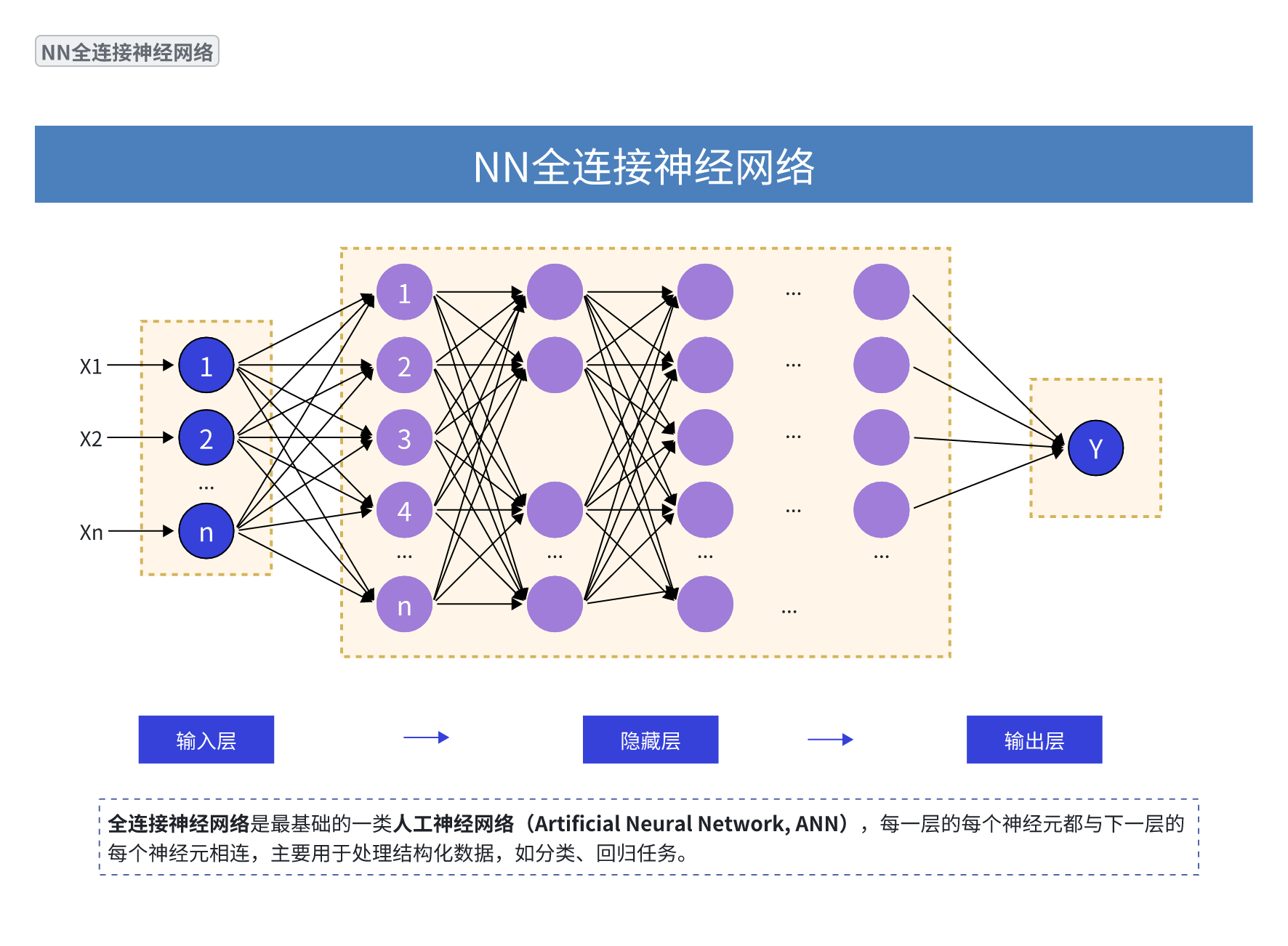

这张图清晰地描绘了神经网络的基本前向传播结构,数据从输入层经过逐层计算和非线性激活,最终到达输出层。这种结构是深度学习的基础,也是许多复杂神经网络模型的组成部分。

这个神经网络由以下几个主要部分组成:

1.输入层(Input Layer):

-

位于最左侧,接收原始输入数据。

-

图中显示了 X1,X2,…,Xn 个输入节点,代表输入数据的不同特征。

2.隐藏层(Hidden Layers):

-

位于输入层和输出层之间。

-

图中展示了多个隐藏层(用虚线框包围),每个隐藏层包含多个神经元(紫色圆圈)。

-

在全连接神经网络中,一个隐藏层中的每个神经元都与前一层的所有神经元相连接,并将输出传递给后一层的每个神经元。这些连接由权重和偏置参数化。

-

隐藏层的数量和每层神经元的数量可以根据具体的任务和数据复杂性进行调整。

3.输出层(Output Layer):

-

位于最右侧,生成网络的最终预测或结果。

-

图中显示了一个输出节点 Y,这可能表示一个二分类问题(例如,输出0或1)或回归问题。对于多分类问题,输出层会有多个节点。

全连接(Fully Connected)的含义是:

-

层与层之间: 前一层的所有神经元都连接到当前层的所有神经元。

-

层内: 同一层内的神经元之间没有连接。

二、什么是全连接神经网络(NN)?

全连接神经网络是最基础的一类人工神经网络(Artificial Neural Network, ANN),每一层的每个神经元都与下一层的每个神经元相连,主要用于处理结构化数据,如分类、回归任务。

也称作 MLP(Multilayer Perceptron,多层感知机)

三、网络结构

1.输入层(Input Layer) 接收原始特征数据,如图像像素值、用户属性等。

2.隐藏层(Hidden Layers) 一层或多层,每个神经元对上一层的输入进行加权求和后,应用激活函数(如 ReLU、Sigmoid)进行非线性变换。

3.输出层