盘古团队声明 回应模型争议

article/2025/7/5 19:04:52

华为近期发布的盘古Pro MoE大模型,通过动态激活专家网络的创新设计,实现了以小打大的优异性能。然而,近日一项发布于GitHub的研究引发业界关注,该研究认为,华为推出的盘古大模型与阿里巴巴发布的通义千问Qwen-2.5 14B模型在参数结构上存在“惊人一致”。

7月5日下午,华为盘古团队发布声明表示,盘古Pro MoE开源模型是基于昇腾硬件平台开发和训练的基础大模型,并非基于其他厂商模型增量训练而来。该模型在架构设计和技术特性方面做了关键创新,是全球首个面向昇腾硬件平台设计的同规格混合专家模型。盘古Pro MoE提出了分组混合专家模型(MoGE)架构,有效解决了大规模分布式训练的负载均衡难题,提升了训练效率。

声明还指出,盘古Pro MoE开源模型部分基础组件的代码实现参考了业界开源实践,涉及其他开源大模型的部分开源代码。华为严格遵循开源许可证的要求,在开源代码文件中清晰标注了开源代码的版权声明。这不仅是开源社区的通行做法,也符合业界倡导的开源协作精神。华为始终坚持开放创新,尊重第三方知识产权,提倡包容、公平、开放、团结和可持续的开源理念。

华为感谢全球开发者与合作伙伴对盘古大模型的关注和支持,高度重视开源社区的建设性意见。希望通过盘古大模型开源,与志同道合的伙伴一起探索并不断优化模型能力,加速技术突破与产业落地。华为欢迎并期待大家在开源社区Ascend Tribe就技术细节进行深入、专业的交流。

相关文章

特朗普为何在独立日签署大而美法案 兑现竞选承诺

7月4日,美国总统特朗普在白宫签署“大而美”税收和支出法案,使之正式成为法律。前一天,美国众议院以218票赞成、214票反对通过了该法案。这一标志性立法延续并扩展了特朗普第一任期的税收政策,调整了联邦支出,并预示其第二任期的施政方向。“大而美法案”体现了特朗普延续…

19岁女生遭侵犯溺亡 凶手被执行死刑 正义终得伸张

7月5日,受害人家属收到法院消息,该案嫌犯陈林已被执行死刑。今年2月28日,河南省高级人民法院改判陈林故意杀人罪死刑,剥夺政治权利终身,并报请最高人民法院核准。河南省高院披露,2024年7月25日晚,陈林和朋友饮酒后驾驶电动三轮车回家,途中遇到被害人闫某在路边玩手机。…

曝以总理与以军总参谋长发生激烈争执 加沙撤离计划引争议

以色列政府3日晚举行闭门内阁会议,讨论加沙地带局势。会议上,总理内塔尼亚胡与国防军总参谋长扎米尔发生激烈争执。内塔尼亚胡提议将加沙平民转移至南部并对北部实施围困,以推翻巴勒斯坦伊斯兰抵抗运动(哈马斯)。扎米尔对这一计划持怀疑态度,质疑谁来管理这200万人口。内…

暴雨致成都“夜游锦江”游船停航 安全考量暂停运营

2025年7月3日,成都遭遇暴雨袭击,导致锦江水位上涨。受此影响,当地热门旅游项目“夜游锦江”游船停航。4日下午,“夜游锦江”项目运营公司发布停航公告,称根据四川省成都水文水资源勘测中心发布的洪水黄色预警,为保障游客安全,锦江游船项目全航段于7月4日临时停航一天。具…

台风“丹娜丝”或在闽浙沿海登陆 东南沿海迎强风雨

南海热带低压已于5日2时在南海东北部海面上加强为今年第4号台风“丹娜丝”。5日至8日,东南沿海部分地区需关注台风影响。中央气象台5日10时继续发布台风蓝色预警。5日13时,“丹娜丝”中心位于台湾鹅銮鼻西偏南约400公里的海面上(北纬20.3度、东经117.4度),中心附近最大风力…

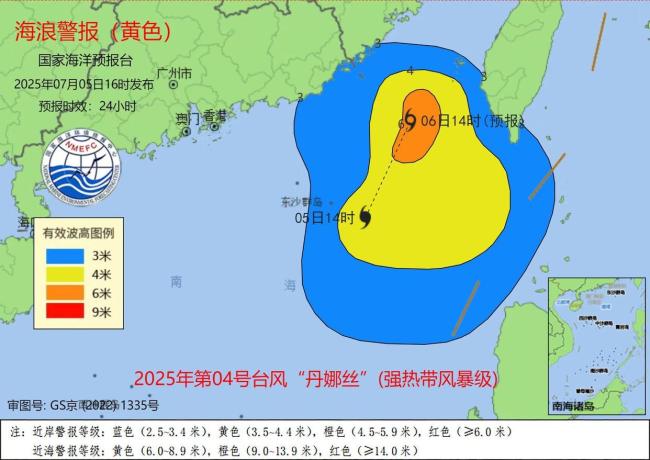

国家海洋预报台发布海浪黄色警报 台风“丹娜丝”影响加剧

自然资源部发布消息称,今年第4号台风“丹娜丝”的中心今天16时位于距离台湾鹅銮鼻西偏南方向约370公里的南海东北部海面上。未来该台风将逐渐转向北偏东方向移动,强度逐渐加强,并向我国台湾岛西南部到福建北部一带沿海靠近。国家海洋预报台根据《海洋灾害应急预案》发布了海…

特朗普曝马斯克吸毒或藏法案博弈阴谋 爆料来源争议

美国作家迈克尔沃尔夫声称,美国总统特朗普表示是他自己向《纽约时报》提供了关于马斯克“吸毒”的消息。此前,《纽约时报》曾报道马斯克在2024年使用了多种违禁药物,但马斯克本人对此予以否认。当地时间7月2日,沃尔夫在接受《每日野兽》网站播客采访时透露,特朗普最近多次…

《侏罗纪世界:重生》表现如何 票房突破2亿

据灯塔专业版实时数据,截至7月5日14时14分,《侏罗纪世界:重生》票房突破2亿。作为“侏罗纪世界”系列的第四部作品,该片也是整个“侏罗纪”IP的第七部电影(包含早期的《侏罗纪公园》三部曲)。前作《侏罗纪世界3》因剧情薄弱口碑下滑(豆瓣6.0分),而《重生》则试图通过科…

鸠山由纪夫:日本应增强对美独立性 构建东亚合作新篇章

7月3日,日本前首相鸠山由纪夫在第十三届世界和平论坛大会上发言,并出席新闻发布会。他主要讨论了特朗普2.0时期日本的应对策略及中日关系的发展前景。鸠山由纪夫指出,在特朗普1.0时期,美国变化最显著的例子是美中之间的对立。而在特朗普2.0时期,这种变化将不再局限于美中关…

美国通过“大而美”法案是怎么回事 加剧财政赤字与债务风险

当地时间7月4日,美国总统特朗普签署了一项名为“大而美”的税收和支出法案,使其正式生效。此前一天,美国国会众议院以218票赞成、214票反对的表决结果通过了该法案。这项法案已于本月1日获得参议院的批准。尽管如此,美国国内仍有人担忧该法案将进一步加剧财政赤字与债务风险…

今天起 国内航线燃油附加费上调 征收标准调整

近日,多家航空公司宣布从2025年7月5日起上调国内航线燃油附加费。具体调整如下:800公里(含)以下航线,每位成人旅客收取10元燃油附加费;800公里以上航线,每位成人旅客收取20元燃油附加费。此前,国内航线燃油附加费在6月5日进行了调整:800公里(含)以下航线免收燃油附加…

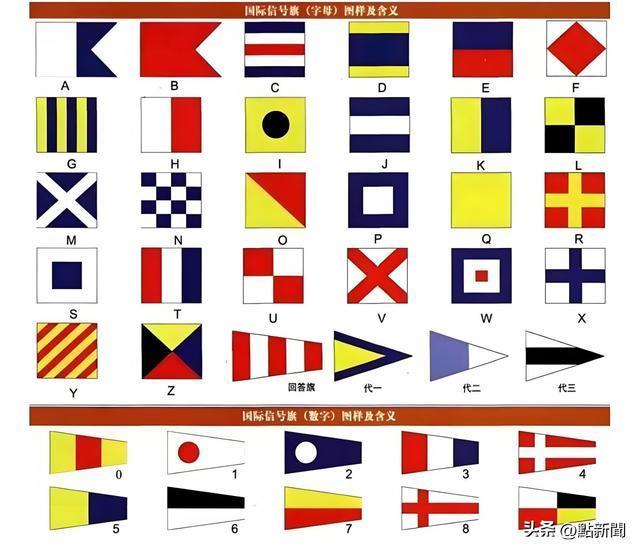

山东舰访港期间悬挂的信号旗有何含义 海军礼仪传统

延安舰悬挂了国旗、海军旗以及LBR信号旗。由航母山东舰,导弹驱逐舰延安舰、湛江舰,导弹护卫舰运城舰组成的海军舰艇编队从3日起访港5天。除了引人瞩目的舰载机和各式武器,军舰主桅杆上形状不一、颜色各异的彩旗组合也大有讲究。这些彩旗学名为海事信号旗,通过不同排列组合对…

原石直播骗局上演“主播被抓”戏码 精心设计的诈骗陷阱

警方发现了一起利用网络直播玉石实施诈骗的案件。在直播间里,主播通过“激情砍价”竞拍原石,并宣称加工后的翡翠制品转卖“稳赚不赔”。然而,这背后其实是一个精心设计的诈骗陷阱。7月4日,上海闵行警方捣毁了一个利用网络直播玉石实施诈骗的犯罪团伙,涉案资金高达150余万元…

知名女演员自曝曾患精神疾病 勇敢面对抑郁症与惊恐症

演员高海宁近日在节目中分享了自己曾经历的抑郁困境。她提到,那段时间她的情绪非常不稳定,甚至有惊恐症等情感上的冲击,让她觉得难以应对,不得不寻求医生的帮助。有一次,她和妈妈去超市购物时,站在路边等待红绿灯,当一辆货车经过时,她脑海中突然闪过一个极端的想法。高…

景区巡防员持镰刀刺破皮艇 当地回应 已严肃处理并调查

7月5日,澎湃新闻报道了浙江温州永嘉县沙头镇岭下村楠溪江景区的一起事件。一名穿着“永嘉巡防”字样背心的工作人员手持镰刀将一块桨板粗暴砍穿,这一行为引起了争议。同日,永嘉县沙头镇政府发布通报,表示损毁桨板的是当地的安全巡查人员,已经对其进行了严肃批评教育,并由…

女生遭侵害落水溺亡 凶手被执行死刑 案件终审判决

7月5日,受害人家属收到法院消息,该案嫌犯陈林已被执行死刑。今年2月28日,河南省高级人民法院作出宣判,对陈林所犯故意杀人罪改判死刑,剥夺政治权利终身,并报请最高人民法院核准。据河南省高院此前披露,2024年7月25日晚,被告人陈林和朋友饮酒后驾驶电动三轮车回家,途中…

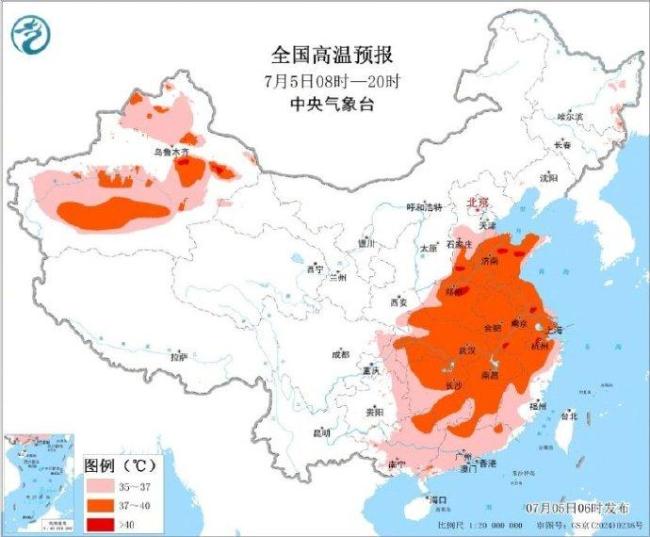

全国多地气温超40摄氏度 大范围持续性高温来袭

未来三天,黄淮、江淮、江汉、江南等地部分地区将迎来大范围持续性高温天气,部分地区气温将达37至39摄氏度,局地最高气温可能超过40摄氏度。具体来看,7月5日白天,华北南部、黄淮、江淮、江汉、江南大部、四川东北部、重庆、华南大部以及新疆南疆盆地和准噶尔盆地等地将出现…

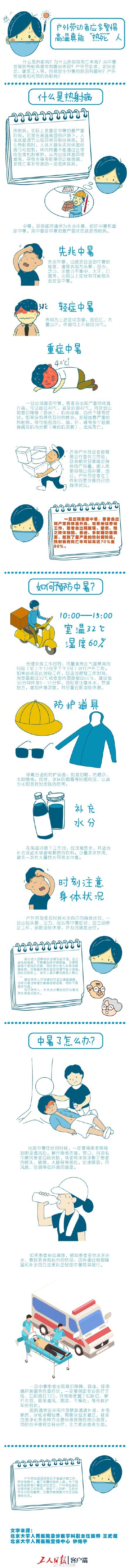

高温天警惕热射病 一图了解防范要点

什么是热射病?为什么热射病死亡率高?从中暑发展到热射病通常有哪些表现?户外劳动者容易发生中暑的原因有哪些?如何预防?出现中暑该怎样应对?一图了解。责任编辑:zhangxiaohua

高温天警惕“热出病” 热射病严重可致命

近日,我国中东部地区正经历今年以来最强的高温过程,南北方多地同时遭受“蒸桑拿”天气。今明两天(7月4日至5日),中东部地区的高温将达到最强时段。高温天气容易引发多种疾病,如何防范和应对这些“高温病”成为关注焦点。高温天气下,人体排汗机制可能崩溃,从而引发一系列…

台风丹娜丝能缓解高温局面吗 大概率不能降温

最近几天天气炎热,云少雨少阳光多。昨天,广州还迎来了全年“最迟日落”。目前海上有了新动静,今年第4号台风“丹娜丝”正式生成。这个台风对广东影响大吗?能带来降温吗?7月5日2时,南海热带低压加强为今年第4号台风“丹娜丝”(热带风暴级)。8时,其中心位于汕头偏南方向…