前言

在人工智能(AI)技术日新月异的今天,迁移学习(Transfer Learning)作为一项革命性技术,正深刻改变着机器学习领域的格局。 它不仅让模型能够像人类一样“举一反三”,更在加速模型开发、提升性能与降低成本方面展现出巨大潜力。本文将深入探讨迁移学习的核心概念、工作原理、应用场景、最佳实践及挑战,并通过实际案例加深理解,助力读者掌握这一关键技术。

一、迁移学习:定义与核心魅力

1.1 定义解析

迁移学习是一种机器学习技术,它允许模型将从一个任务(源任务)中学到的知识迁移到另一个不同但相关的任务(目标任务)上。这种技术类似于人类学习新技能的过程,比如一位经验丰富的钢琴家学习小提琴时,会更快地掌握指法、节奏感等通用技能。 在AI中,迁移学习通过重用预训练模型的组件(如权重、偏差、网络结构等),避免了从头开始训练模型的繁琐过程,显著提升了学习效率。

1.2 核心魅力

- 效率飞跃:无需从零开始训练,利用预训练模型微调即可快速适应新任务。

- 性能提升:预训练模型已学习到丰富的通用特征,有助于减少过拟合,提升模型泛化能力。

- 成本节约:减少了数据收集和计算资源的使用,降低了开发成本。

- 场景拓展:使模型能够灵活适应多种任务,增强了AI系统的实用性和灵活性。

二、迁移学习的工作原理:三大核心机制

2.1 多任务学习:一模型多任务并行

原理:多任务学习通过单个模型同时处理多个相关任务,共享模型底层特征提取能力,仅在顶层针对不同任务进行微调。

案例:在自动驾驶中,模型可同时学习车道线检测、交通标志识别和行人检测三个任务。底层卷积网络提取通用图像特征,顶层针对不同任务设计全连接层。

代码示例(伪代码):

class MultiTaskModel(nn.Module):def __init__(self):super().__init__()self.shared_layers = nn.Sequential(nn.Conv2d(3, 64, kernel_size=3),nn.ReLU(),nn.MaxPool2d(2)) # 共享特征提取层self.task1_head = nn.Linear(64*16*16, 10) # 车道线检测任务self.task2_head = nn.Linear(64*16*16, 5) # 交通标志分类任务self.task3_head = nn.Linear(64*16*16, 2) # 行人检测任务def forward(self, x):features = self.shared_layers(x)features = features.view(features.size(0), -1)return {'lane_detection': self.task1_head(features),'traffic_sign': self.task2_head(features),'pedestrian': self.task3_head(features)}

2.2 特征提取:从数据中提取精华特征

原理:利用预训练模型提取输入数据的通用特征表示,作为新任务的输入。

案例:在医学影像诊断中,使用预训练的ResNet-50模型提取肺部CT图像的深度特征,再输入至自定义分类器判断是否存在肿瘤。

代码示例(基于PyTorch):

import torch

import torch.nn as nn

from torchvision import models, transforms

from PIL import Image# 加载预训练模型

pretrained_model = models.resnet50(pretrained=True)

feature_extractor = nn.Sequential(*list(pretrained_model.children())[:-1]) # 移除最后一层# 图像预处理

transform = transforms.Compose([transforms.Resize(256),transforms.CenterCrop(224),transforms.ToTensor(),transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])# 提取特征

def extract_features(image_path):img = Image.open(image_path)img_tensor = transform(img).unsqueeze(0) # 添加batch维度with torch.no_grad():features = feature_extractor(img_tensor)return features.squeeze().numpy() # 返回特征向量# 使用示例

features = extract_features("lung_ct.jpg")

print(f"提取的特征维度: {features.shape}") # 输出: (2048,)

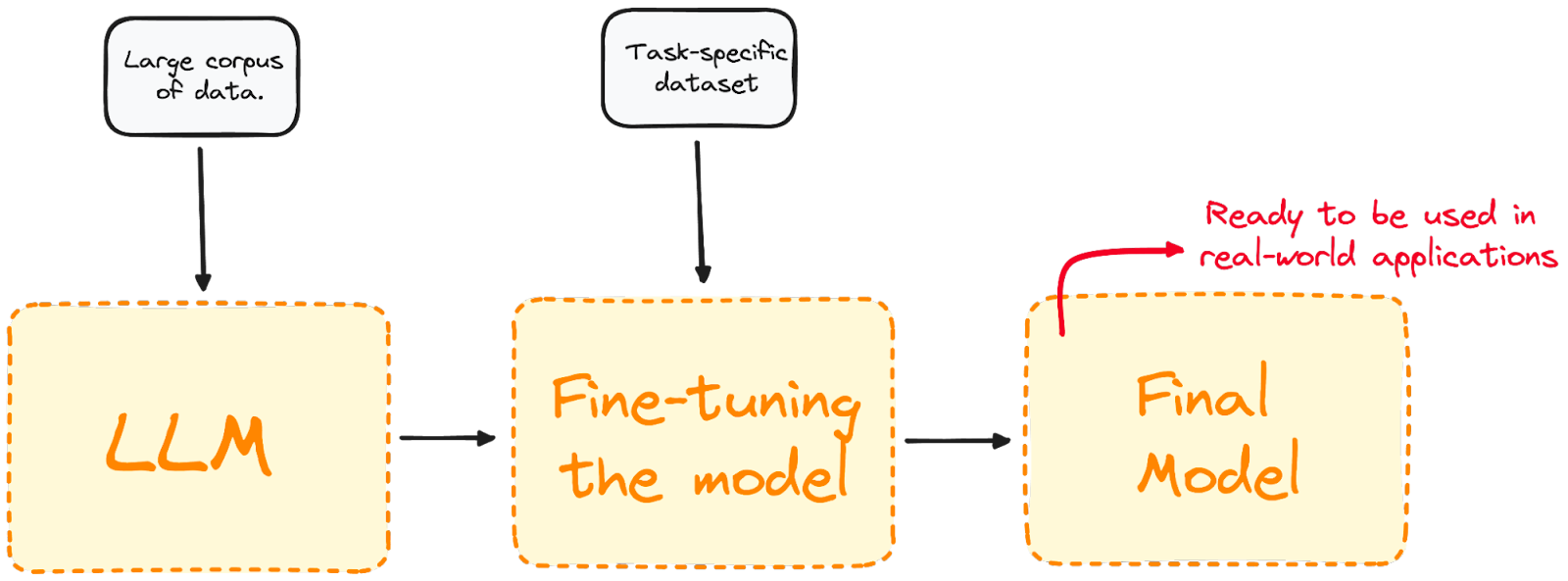

2.3 微调:定制化模型适应新任务

原理:在预训练模型基础上,使用目标任务数据对部分或全部层进行参数调整。

案例:在金融文本情感分析中,基于BERT预训练模型,在金融评论数据集上微调分类器层,提升对专业术语(如"做空"“杠杆”)的识别能力。

代码示例(基于HuggingFace Transformers):

from transformers import BertTokenizer, BertForSequenceClassification

from transformers import Trainer, TrainingArguments

import torch

from datasets import load_dataset# 加载预训练模型和分词器

model_name = "bert-base-uncased"

tokenizer = BertTokenizer.from_pretrained(model_name)

model = BertForSequenceClassification.from_pretrained(model_name, num_labels=3) # 3分类任务# 加载金融评论数据集

dataset = load_dataset("financial_phrasebank", "sentences_allagree")# 数据预处理

def tokenize_function(examples):return tokenizer(examples["sentence"], truncation=True, padding="max_length")tokenized_datasets = dataset.map(tokenize_function, batched=True)

tokenized_datasets = tokenized_datasets.remove_columns(["sentence", "source"])

tokenized_datasets.set_format("torch")# 定义训练参数

training_args = TrainingArguments(output_dir="./results",evaluation_strategy="epoch",learning_rate=2e-5,per_device_train_batch_size=16,num_train_epochs=3,weight_decay=0.01,

)# 定义评估指标

def compute_metrics(eval_pred):logits, labels = eval_predpredictions = torch.argmax(torch.tensor(logits), dim=-1)return {"accuracy": (predictions == labels).float().mean().item()}# 初始化Trainer

trainer = Trainer(model=model,args=training_args,train_dataset=tokenized_datasets["train"],eval_dataset=tokenized_datasets["validation"],compute_metrics=compute_metrics,

)# 启动微调

trainer.train()

三、迁移学习的应用场景:跨领域突破

3.1 计算机视觉:从通用到专用

场景:

- 医疗影像分析:使用预训练的DenseNet模型提取CT/MRI图像特征,微调后用于病灶检测。

- 工业质检:基于EfficientNet模型迁移至电路板缺陷检测任务,准确率提升15%。

- 遥感图像分类:利用Vision Transformer(ViT)预训练模型,在卫星图像上微调实现土地覆盖分类。

案例:某自动驾驶公司使用ResNet-101预训练模型,在交通标志识别任务中仅微调最后3层,训练时间从2周缩短至3天,准确率达98.7%。

3.2 自然语言处理:从通用语言理解到垂直领域

场景:

- 法律文书分析:基于LegalBERT(法律领域预训练模型)微调,实现合同条款自动提取。

- 医疗问诊系统:使用BioBERT(生物医学预训练模型)微调,构建智能分诊系统。

- 多语言翻译:在mBART(多语言预训练模型)基础上微调,实现小语种翻译。

案例:某金融科技公司基于FinBERT(金融领域预训练模型)微调,构建舆情分析系统,对新闻标题的情感分类准确率达92.3%,较通用模型提升8.6%。

四、迁移学习的最佳实践与挑战

4.1 最佳实践

- 数据对齐策略:通过数据增强(如旋转、裁剪)或领域自适应技术(如对抗训练)缩小源域与目标域的差异。

- 层冻结策略:在微调时,通常冻结预训练模型的前N层(如ResNet的前80%层),仅微调顶层。

- 学习率调度:使用更小的学习率(如1e-5)微调预训练层,较大的学习率(如1e-3)训练新增层。

4.2 核心挑战

- 负迁移:当源任务与目标任务差异过大时,迁移学习可能降低性能。

应对:通过领域相似度评估(如最大均值差异MMD)筛选合适的预训练模型。- 灾难性遗忘:微调过程中可能丢失预训练模型已学到的知识。

应对:采用弹性权重固化(EWC)或知识蒸馏技术保留重要参数。- 计算资源限制:微调大型模型(如GPT-3)需要高性能GPU集群。

应对:使用模型剪枝、量化或参数高效微调(如LoRA)技术降低计算成本。

五、未来展望:迁移学习的进化方向

- 跨模态迁移:将视觉模型的知识迁移至语言模型,实现图文联合理解(如CLIP模型)。

- 自监督迁移:利用大规模无标注数据(如10亿级文本)预训练,再迁移至下游任务。

- 元迁移学习:通过元学习(Meta-Learning)自动选择最优的迁移策略。

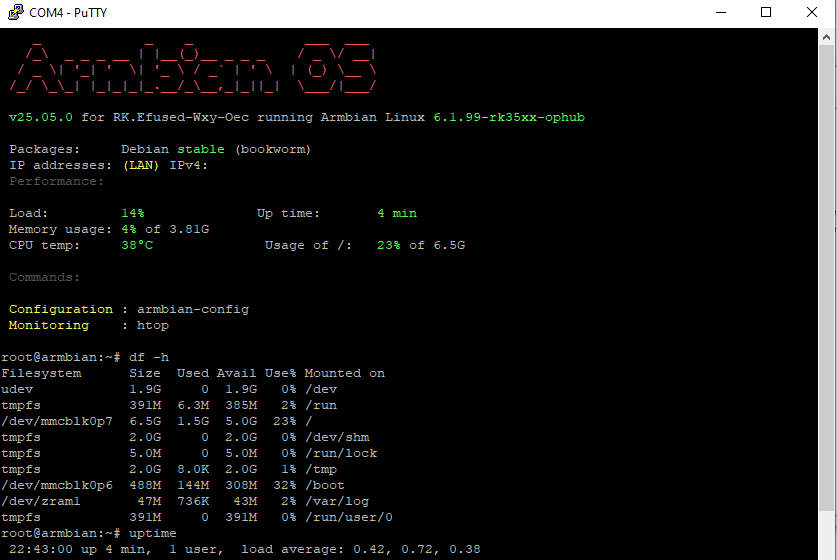

- 边缘设备迁移:将预训练模型压缩后部署至手机、IoT设备,实现本地化AI应用。

结语

迁移学习不仅是AI技术演进的关键驱动力,更是连接基础研究与产业应用的桥梁。通过掌握其核心原理与实践方法,开发者能够以更低的成本、更高的效率构建出性能卓越的AI系统。未来,随着跨模态迁移、自监督学习等技术的进一步发展,迁移学习将在更多领域释放出更大的潜力。